94% des étudiants ont déjà utilisé un outil d’IA dans leur vie personnelle ou étudiante, 48% l’utilisent tous les jours, un étudiant sur deux reconnaît qu’il lui serait difficile de s’en passer, en particulier pour ses études selon une Enquête sur la perception et l’usage de l’IA chez les étudiants de l’enseignement supérieur français menée en février 2026 par l’Ipsos pour l’Epita. Mais avec quels effets ? Selon une vaste étude The AI Challenge How College Faculty Assess the Present and Future of Higher Education in the Age of AI menée fin 2025 auprès de plus de mille enseignants de l’enseignement supérieur supérieur aux États-Unis, l’intelligence artificielle générative bouleverse déjà en profondeur les pratiques pédagogiques. Entre espoirs d’innovation et craintes massives pour l’intégrité académique, l’esprit critique et la valeur des diplômes, les enseignants y dressent le portrait d’un système sous tension, sommé de se réinventer sans renoncer à ses principes fondamentaux.

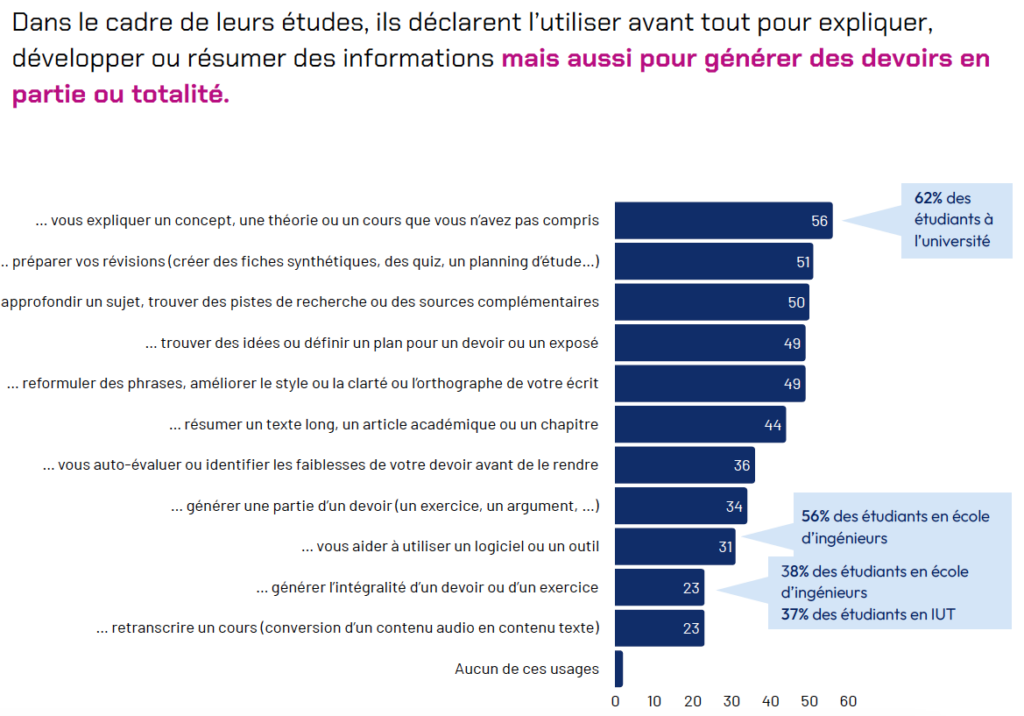

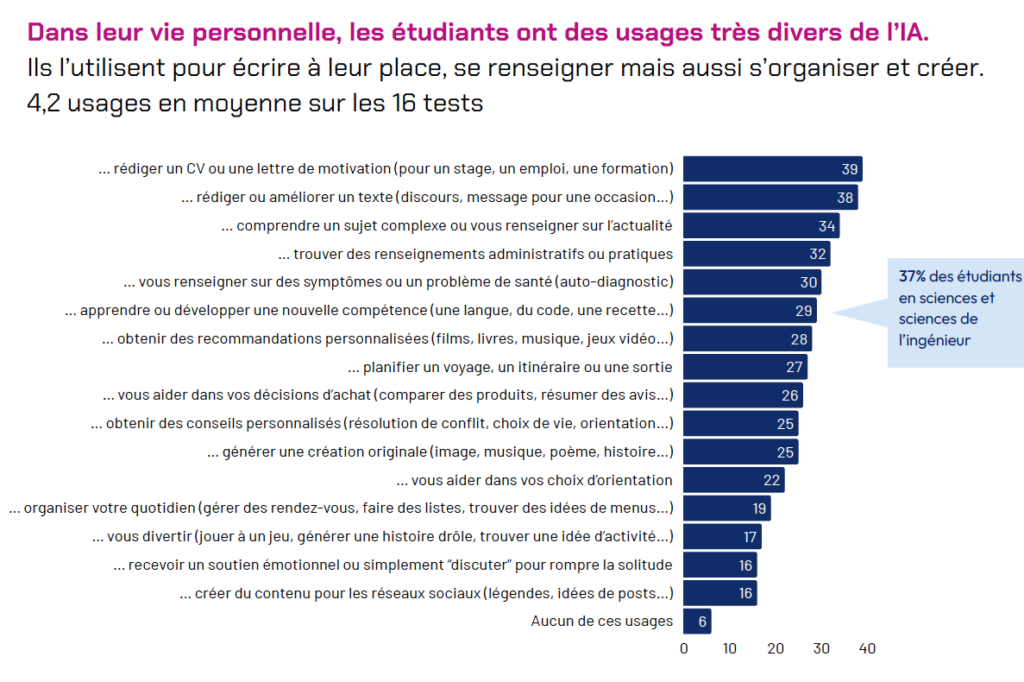

Une utilisation massive. Dans le cadre de leurs études, les étudiants utilisent principalement l’IA pour comprendre, résumer ou approfondir des contenus. Mais l’enquête de l’Ipsos pour l’Epita met également en lumière des pratiques plus sensibles :

- 40% des étudiants reconnaissent avoir déjà utilisé l’IA pour générer tout ou partie d’un devoir ;

- 47% déclarent s’en servir pour des exercices même lorsque cela n’est pas autorisé.

Source : Enquête sur la perception et l’usage de l’IA chez les étudiants de l’enseignement supérieur français

Source : Enquête sur la perception et l’usage de l’IA chez les étudiants de l’enseignement supérieur français

Les étudiants estiment majoritairement savoir interagir efficacement avec les outils d’IA :

- 78% se disent capables d’affiner les réponses par itérations et d’évaluer la pertinence des résultats ;

- En revanche 81% se déclarent mal informés sur au moins un enjeu majeur lié à l’IA (éthique, biais, sécurité, environnement ou cadre réglementaire), et plus d’un sur deux sur la moitié de ces enjeux.

Source : Enquête sur la perception et l’usage de l’IA chez les étudiants de l’enseignement supérieur français

Source : Enquête sur la perception et l’usage de l’IA chez les étudiants de l’enseignement supérieur français

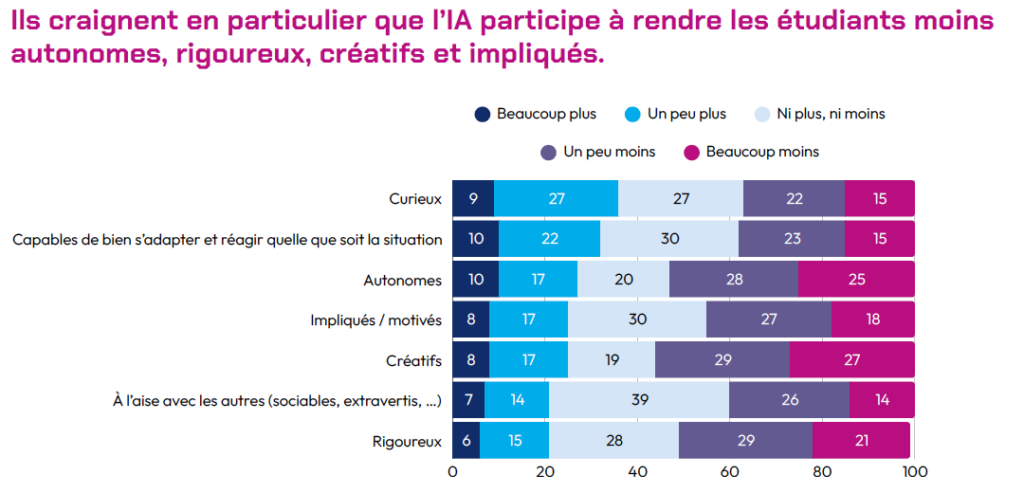

Les étudiants craignent en particulier que l’IA participe à rendre les étudiants moins autonomes, rigoureux, créatifs et impliqués.

Source : Enquête sur la perception et l’usage de l’IA chez les étudiants de l’enseignement supérieur français

Source : Enquête sur la perception et l’usage de l’IA chez les étudiants de l’enseignement supérieur français

L’intelligence artificielle, un choc sans précédent pour les universités. Jamais une technologie n’avait pénétré aussi rapidement les universités aux Etats-Unis. En quelques mois, les outils d’intelligence artificielle générative se sont imposés dans les pratiques étudiantes comme dans les réflexions institutionnelles. Chatbots, assistants rédactionnels, générateurs de code ou de synthèses sont devenus des compagnons ordinaires du travail universitaire. Face à cette irruption, les enseignants de l’enseignement supérieur américain expriment un sentiment partagé : celui d’un bouleversement profond, à la fois inévitable et déstabilisant. L’enquête conduite par l’American Association of Colleges and Universities et l’université Elon montre que plus de huit enseignants sur dix estiment que leur métier sera durablement transformé.

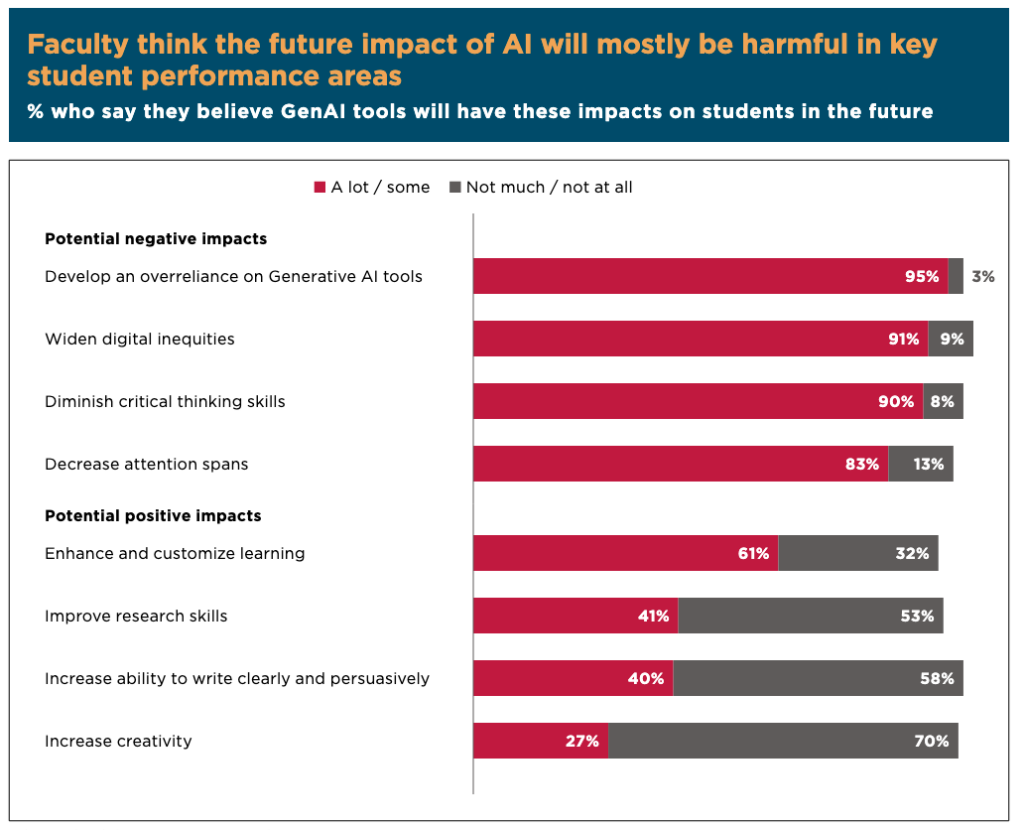

Le premier signal d’alarme concerne les étudiants. Pour une immense majorité des enseignants interrogés, l’IA favorise une dépendance croissante aux outils numériques. Près de 95% redoutent une surutilisation qui affaiblirait l’autonomie intellectuelle. Cette inquiétude se prolonge sur plusieurs plans :

- 90% anticipent une baisse de l’esprit critique,

- 83% une diminution de la capacité d’attention,

- plus de 80% une aggravation des inégalités numériques.

Nous voyons émerger la « crainte d’une génération d’étudiants tentée de déléguer ses efforts cognitifs à des systèmes automatisés, au risque d’appauvrir ses compétences fondamentales ». Dans ce contexte, la promesse d’efficacité se double d’un soupçon de fragilisation intellectuelle.

« L’économie de l’attention » : comment faire face à la crise cognitive. Dans un article intitulé The Attention Economy’s Challenge: How Business Schools Must Address the Cognitive Crisis, publié dans la revue Global Focus de l’EFMD, Sébastien Tran, directeur général d’Audencia, s’interroge sur comment la prolifération des écrans, des réseaux sociaux et désormais de l’intelligence artificielle affaiblit progressivement les capacités cognitives des étudiants : « Plusieurs études montrent que la dépendance à l’IA favorise la paresse intellectuelle, réduit la créativité et affaiblit l’esprit critique ».

Les étudiants s’appuient en effet de plus en plus sur des outils capables de produire instantanément des réponses, des résumés ou des analyses. Cette facilité « crée un cercle vicieux : moins l’effort est sollicité, plus les capacités de réflexion diminuent, et plus la tentation des raccourcis technologiques augmente ».

Cette situation s’inscrit dans ce que les chercheurs appellent « l’économie de l’attention », un système dans lequel les plateformes numériques captent en permanence la concentration humaine. Les interruptions fréquentes fragmentent la pensée et rendent le travail approfondi de plus en plus difficile.

Les conséquences dépassent le cadre universitaire. Les employeurs « constatent chez les jeunes diplômés un manque de persévérance, des difficultés face à la complexité et des faiblesses dans l’analyse critique ».

Face à cette crise, les écoles de management doivent agir. Sébastien Tran propose plusieurs pistes : « créer des espaces favorisant la concentration, intégrer la gestion de l’attention dans les programmes, repenser les méthodes d’évaluation, renforcer le sens collectif du travail intellectuel et former les étudiants à un usage raisonné de l’IA ».

L’objectif est de développer une « souveraineté cognitive » : la capacité à choisir consciemment comment utiliser la technologie, plutôt que de la subir.

Source : enquête The AI Challenge How College Faculty Assess the Present and Future of Higher Education in the Age of AI

Source : enquête The AI Challenge How College Faculty Assess the Present and Future of Higher Education in the Age of AI

L’intégrité académique sous pression. Autre front majeur : la triche. Selon l’enquête, près de huit enseignants sur dix estiment que les fraudes ont augmenté depuis la généralisation de l’IA générative. Plus des deux tiers déclarent avoir déjà été confrontés à des cas concrets.

La difficulté principale réside dans la preuve. Les outils de détection sont jugés peu fiables. Seuls 23% des enseignants les considèrent efficaces. Beaucoup préfèrent donc miser sur leur intuition, au risque de conflits et d’injustices.

Nous entrons dans une zone grise où la frontière entre assistance légitime et fraude devient floue. Faut-il considérer comme triche l’usage d’un plan généré par IA ? La reformulation automatique d’un texte ? L’amélioration stylistique d’un devoir ? Sur ces questions, le corps enseignant apparaît profondément divisé.

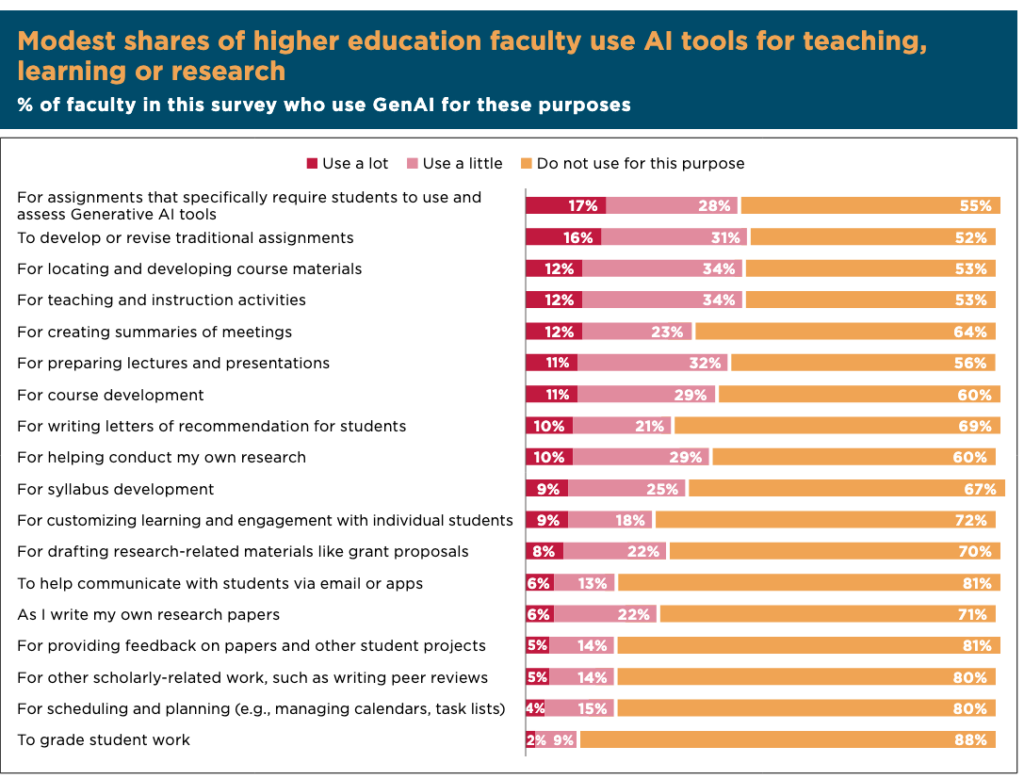

Des pratiques enseignantes hésitantes. Contrairement à certaines idées reçues, l’IA n’est pas massivement adoptée par les enseignants. Un quart d’entre eux déclarent ne jamais l’utiliser. Un tiers refuse de s’en servir dans l’enseignement. La majorité reste prudente. Peu recourent à l’IA pour préparer leurs cours, corriger les copies ou communiquer avec les étudiants. Les usages les plus répandus concernent la conception d’exercices ou l’expérimentation pédagogique.

Cette retenue reflète plusieurs obstacles :

- un manque de formation,

- une méfiance vis-à-vis des résultats produits,

- des doutes éthiques,

- une résistance culturelle.

Les auteurs de l’étude observent ainsi un « décalage croissant entre des étudiants très équipés et des enseignants encore en phase d’appropriation ».

Source : enquête The AI Challenge How College Faculty Assess the Present and Future of Higher Education in the Age of AI

Source : enquête The AI Challenge How College Faculty Assess the Present and Future of Higher Education in the Age of AI

L’enquête dresse également un constat sévère sur l’état de préparation des universités. Près de 60% des enseignants estiment que leur établissement n’est pas prêt à former efficacement les étudiants à l’IA. Plus de deux tiers jugent que le personnel enseignant n’a pas reçu d’accompagnement suffisant. Même diagnostic pour les fonctions administratives, la recherche ou la gestion institutionnelle. L’IA progresse plus vite que les structures d’encadrement. Certes, certaines universités ont mis en place des groupes de travail, des chartes ou des formations. Mais ces initiatives restent inégalement réparties et souvent fragmentées. « Nous faisons face à une transition technologique sans véritable stratégie collective stabilisée », analyse l’étude.

L’urgence de la littératie numérique. Dans ce paysage incertain, un consensus émerge : la nécessité de former les étudiants à un usage critique de l’IA. Près de 70% des enseignants abordent désormais en cours les questions d’éthique, de biais, de désinformation, de confidentialité ou d’hallucinations algorithmiques.

La littératie en IA ne se limite plus à savoir utiliser un outil. Elle implique de comprendre ses limites, ses logiques économiques, ses risques sociopolitiques.

Les enseignants insistent notamment sur :

- la vérification des sources,

- la maîtrise de l’écriture autonome,

- le raisonnement argumenté,

- la capacité à douter.

Selon l’étude, nous assistons à un « déplacement du rôle pédagogique, qui passe de la transmission de contenus à la formation du jugement ».

Des bénéfices limités, des risques majeurs. Loin d’un rejet systématique, les enseignants reconnaissent certains apports. Environ 60% estiment que l’IA peut favoriser une personnalisation des apprentissages. Certains y voient un outil d’aide à la remédiation ou à l’inclusion.

Mais ces bénéfices apparaissent fragiles face à l’ampleur des inquiétudes. Moins de la moitié pensent que l’IA améliorera réellement les capacités de recherche ou d’écriture. Une majorité doute de son impact positif sur la créativité.

Sur le plan professionnel, près d’un enseignant sur deux craint une dégradation des perspectives d’emploi pour ses étudiants. Trois quarts redoutent une dévalorisation des diplômes. « Nous percevons ainsi un sentiment diffus de déclassement académique », en concluent les auteurs de l’étude.

Un débat éthique encore inabouti. L’IA pose des questions qui dépassent la pédagogie : propriété intellectuelle, exploitation des données, empreinte écologique, biais discriminatoires, manipulation informationnelle. Sur tous ces sujets, plus de deux tiers des enseignants estiment qu’un enseignement spécifique est nécessaire. Pourtant, peu d’établissements disposent de cadres clairs. L’absence de normes partagées « fragilise la légitimité des décisions individuelles. Chaque enseignant improvise ses règles. Chaque étudiant teste les limites ». On évolue dans un « espace normatif instable, propice aux tensions ».

Au-delà des chiffres, l’enquête révèle une inquiétude plus profonde : celle d’une perte de sens. De nombreux enseignants rappellent que l’apprentissage suppose de la difficulté, de l’effort, de la lenteur. Or « l’IA promet des raccourcis. Elle menace, selon eux, le processus même par lequel se construit la connaissance ».

Face à cette tension, beaucoup plaident pour un recentrage sur les fondamentaux et « une défense du temps long contre la logique de l’instantanéité »:

- lecture approfondie,

- écriture comme outil de pensée,

- débat argumenté,

- autonomie intellectuelle.

Façonner l’usage plutôt que le subir. La conclusion du rapport est sans ambiguïté : l’IA s’imposera dans l’enseignement supérieur. La question n’est pas de savoir si elle transformera l’université, mais comment.

Les enseignants américains disent refuser une intégration aveugle. Ils réclament :

- des politiques claires,

- des investissements en formation,

- une réflexion collective,

- une gouvernance éthique.

Ils appellent à « reprendre la main sur un outil qui, sans régulation, risque de dicter ses propres règles ». Nous sommes ainsi « placés devant un choix historique : laisser la technologie redéfinir l’éducation, ou décider collectivement des conditions de son usage » conclut l’étude. Et nous n’en sommes qu’au début de l’histoire…

- L’enquête d’Ipsos pour l’Epita a été menée sur un échantillon de 1000 étudiants dans l’enseignement supérieur en France, représentatifs de cette population du 2 au 18 janvier 2026.

- Lire aussi : Generative AI is not just a tool for learning. It shapes how students think (Times Higher Education)

Source : Image issue de Highlights : TA Trends 2026 Human-AI Power Couple du cabinet Korn Ferry

IA vs. JD ?. Selon l’enquête d’Ipsos pour l’Epita 59% des étudiants estiment que l’IA pourrait menacer l’existence de leur futur métier. En septembre 2025 une étude menée par l’Université de Stanford intitulée Canaries in the Coal Mine? Six Facts about the Recent Employment Effects of Artificial Intelligence sonnait la sirène d’alarme. La génération actuelle de jeunes diplômés est de plus en plus impactée négativement par le progrès technologique. Selon l’étude depuis l’adoption généralisée de l’IA générative, les professionnels en début de carrière (âgés de 22 à 25 ans) dans les métiers les plus exposés à l’IA ont connu une baisse relative de 13% de l’emploi, même après avoir pris en compte les chocs au niveau des entreprises. « On se recentre sur la formation de ceux dont les jobs seront vite supprimés par l’IA… Alors que, face aux défis énergétiques, sociaux et climatiques, il nous faut encore plus de scientifiques et d’ingénieurs proches du technique et du concret dont les capacités de réalisation sur dopées par l’IA… » dénonce Laurent Champaney, directeur général des Arts et Métiers.

Mais est-ce vraiment une fatalité ? Fortune révèle par exemple qu’IBM is tripling the number of Gen Z entry-level jobs after finding the limits of AI adoption. « Les entreprises qui connaîtront le plus grand succès dans trois à cinq ans sont celles qui ont misé sur le recrutement de jeunes diplômés dans le contexte actuel », explique ainsi Nickle LaMoreaux, directeur des ressources humaines chez IBM.

Cette question des disparitions d’emplois liées aux IA est abordée de façon nuancée par le prix Nobel d’économie et professeur à l’Insead Philippe Aghion : « Certaines tâches routinières, notamment cognitives, sont susceptibles d’être automatisées. Mais l’IA devrait également créer de nouveaux métiers et renforcer la compétitivité des entreprises, ce qui pourrait stimuler la demande et l’emploi ». Pour rendre cette transition socialement soutenable, il souligne « l’importance de modèles institutionnels adaptés, comme la flexisécurité à la danoise, ainsi qu’un système éducatif solide, centré sur les fondamentaux et la capacité à apprendre tout au long de la vie ».